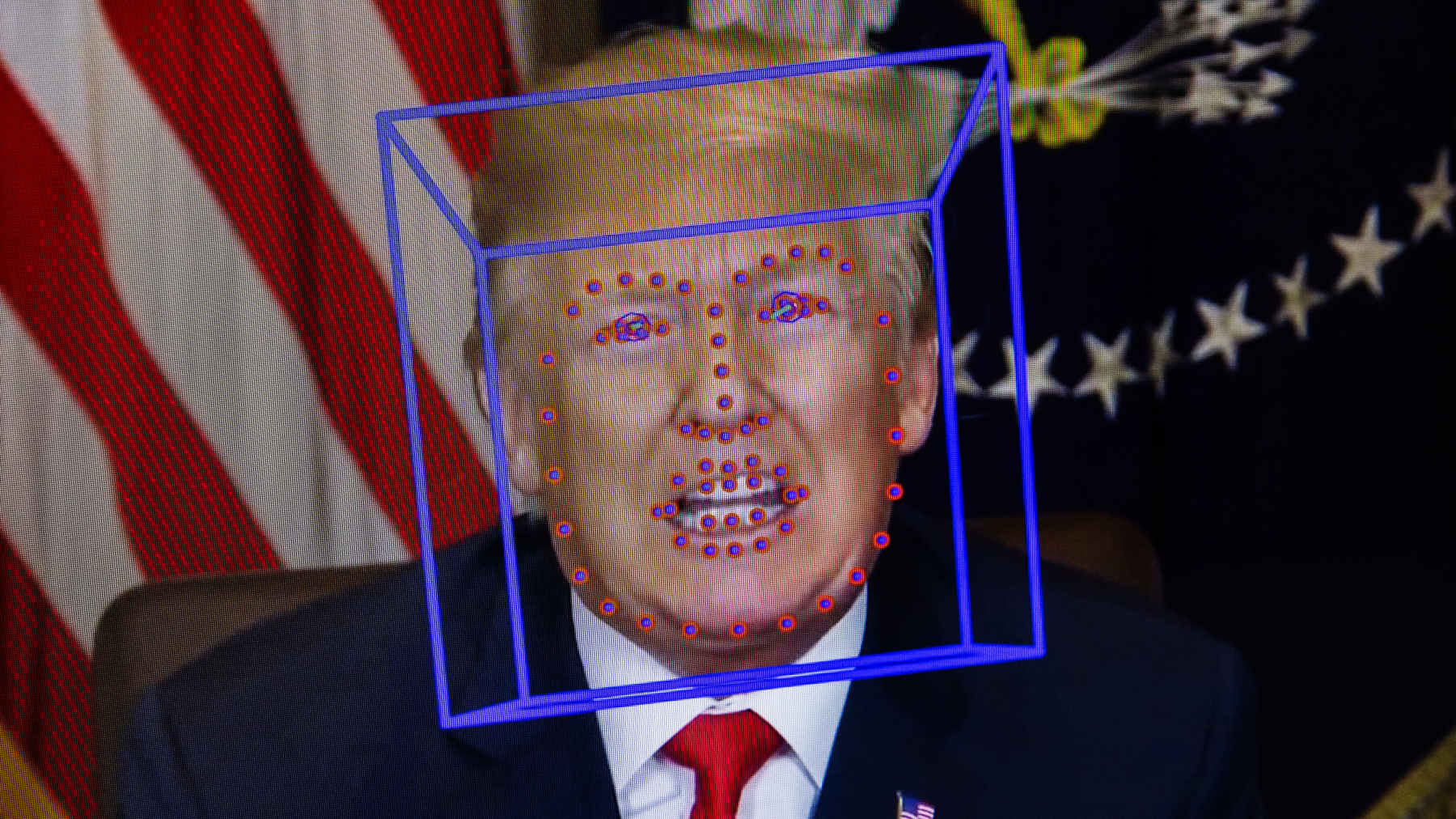

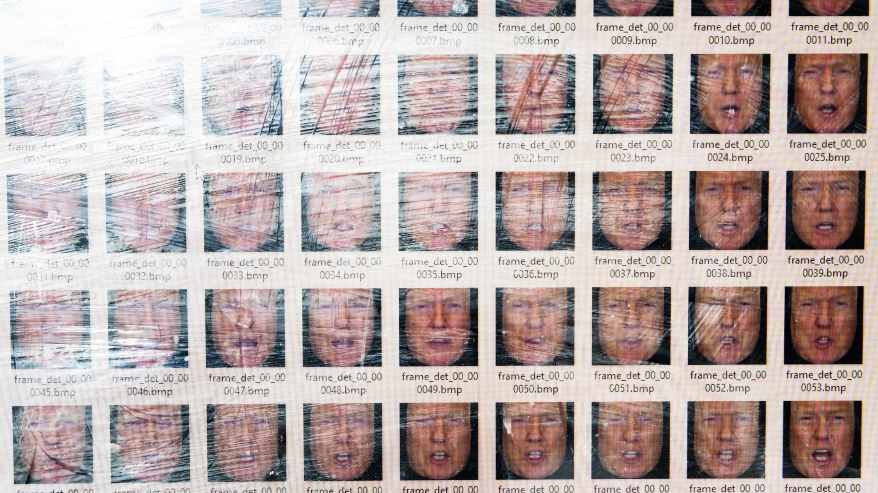

PUSHKAR/KOLKATA Tutuille kasvoille ilmestyy sinisiä pisteitä ja kehikko. Donald Trump tuijottaa tietokoneen suurelta ruudulta.

Intialainen startup-yrittäjä Divyendra Singh Jadoun käynnistää videon, ja Trump alkaa puhua amerikkalaisella aksentilla suomea:

”Hei Mikko, toivottavasti voit hyvin”.

Ääni kuulostaa hämmentävän aidolta.

Uudelleen Yhdysvaltain presidentiksi pyrkivä Trump ei ole opetellut suomea lähettääkseen terveisiä toimittajalle. Kyseessä on tekoälyn avulla tehty syväväärennös eli niin sanottu deepfake.

Jadoun käyttää usein juuri tätä videota, kun hän haluaa näyttää taitojaan asiakkaille. Vale-Trumpin voi laittaa hetkessä puhumaan mitä tahansa.

Yle ei pyytänyt Jadounia väärentämään Trumpin puhetta.

Katso alla olevalta videolta, kuinka vale-Trump puhuu suomea. Toisessa videossa näkyy, miten Jadoun teki syväväärennöksen. Työtä hidasti muun muassa sähkökatkos, ja aikaa videon tekemiseen kului noin tunti.

SYVÄVÄÄRENNÖKSISTÄ ON TULLUT merkittävä vaaliase Intiassa. Jättivaltiossa on parhaillaan käynnissä kuusi viikkoa kestävät parlamenttivaalit.

Puolueet ja niiden kannattajat käyttävät väärennöksiä esimerkiksi vastustajien mustamaalaamiseen.

Tiedossa on myös tapauksia, joissa kuollut poliittinen johtaja ”herätetään henkiin”. Käytännössä digitaalinen versio vainajasta valjastetaan auttamaan kampanjoinnissa.

Asiantuntijat varoittavat, että väärinkäytettynä deepfake-teknologia vaarantaa demokratian.

Huoli koskee myös kesäkuussa järjestettäviä europarlamenttivaaleja.

EU:n viranomaiset ovat epäilleet, että esimerkiksi Venäjä tai muut toimijat voivat pyrkiä vaikuttamaan syväväärennösten avulla vaaleihin, kertoo The Guardian.

Jadounin johtama firma The Indian Deepfaker on hyvä esimerkki siitä, mitä kaikkea syväväärennöksillä jo tehdään politiikassa.

Deepfake-paja on Jadounin kotitalon alakerrassa kalterioven takana.

Talon yläkerrassa asuvat hänen lisäkseen vanhemmat ja veli.

Talo sijaitsee Pushkarin pikkukaupungissa.

Jadoun voisi menestyä Intian IT-keskuksissa kuten Bengalurussa, mutta hän haluaa asua lähellä vanhempiaan.

ALUKSI JADOUNIN YRITYS teki deepfakeja elokuva- ja mainosteollisuudelle.

Niissä esimerkiksi vaihdettiin näyttelijälle toisen ihmisen kasvot tai heidän ikäänsä muokattiin. Yritys myös dubbasi elokuvia tekoälyn kloonaamilla äänillä. Näin näyttelijät saadaan puhumaan eri kieliä omalla äänellään.

– Voimme tehdä näyttelijästä nuoremman näköisen, lapsiversion tai vanhemman version, Jadoun kuvailee.

Viime vuoden lopussa tapahtui käänne.

Firmalle tuli yllättäen parisataa pyyntöä tuottaa syväväärennöksiä paikallisvaaleihin. Lähes puolet pyynnöistä koski videoita, joiden tarkoitus oli vahingoittaa jotain tahoa, Jadoun sanoo.

FIRMA KIELTÄYTYY mustamaalaavista työtehtävistä, Jadoun sanoo.

Hän kuitenkin toteaa, että välillä on hankala määrittää, onko jonkin sisällön toteuttaminen oikein vai väärin. Jossain menee silti raja.

– Emme tee deepfakeja, jotka halventavat toisia ihmisiä. Voimme tehdä sisältöjä, joissa kehutaan ihmistä tai puoluetta.

Tyypillisesti kyselijät pyytävät kahdenlaisia väärennöksiä, joilla voi vahingoittaa vastustajaa, Jadoin kertoo.

Hänen mukaansa yleisin esimerkki on pornovideo, jossa näyttelijälle vaihdetaan poliittisen vastustajan kasvot.

Myös poliitikon tai muun merkkihenkilön puheen väärentäminen on yleinen vaalivaikuttamisen tapa. Käytännössä henkilö laitetaan äänenkloonauksen avulla sanomaan asioita, joita hän ei ole oikeasti sanonut.

Esimerkiksi huhtikuussa somessa levisi deepfake-videoita, joissa kaksi Bollywood-tähteä näyttivät arvostelevan pääministeri Narendra Modia ja kehottivat äänestämään oppositiopuoluetta.

Näyttelijät tekivät väärennöksistä rikosilmoitukset.

THE INDIAN DEEPFAKER ON jälleen saanut useilta eri puolueilta toimeksiantoja käynnissä olevien parlamenttivaalien takia, Jadoun kertoo.

Salassapitosopimusten vuoksi hän ei paljasta asiakkaiden nimiä.

– Periaatteessa korvaamme perinteisiä kampanjointimenetelmiä soveltamalla tekoälyä.

Ylen vierailun aikoihin Jadounin tiimillä oli työn alla deepfake-video, jolla noin 15 vuotta sitten helikopterionnettomuudessa kuollut poliitikko kehottaa äänestämään parlamenttiin pyrkivää poikaansa.

Jadounin yritys tehtailee myös eräänlaisia tekoälyajan kiitoskortteja: puolueen johtaja kiittää videolla kampanjatyöntekijää mainitsemalla tämän nimen. Henkilökohtainen puhe on väärennetty tekoälyllä.

Hänen firmansa luo myös hologrammeja poliittisista johtajista. Silloin vaalijulisteisiin liitetään QR-koodi, jota skannaamalla johtajan hologrammihahmo ilmestyy käyttäjän puhelimen näytölle kampanjoimaan.

Jadounin mukaan The Indian Deepfaker ei luo syväväärennöksiä, joissa poliitikko pyytää tiettyä äänestäjää antamaan äänensä juuri hänelle. Kilpailevat yritykset tuottavat jo niitäkin, hän sanoo.

SYVÄVÄÄRENNÖSTEN TEKEMISESTÄ on tullut helppoa, ja ilmiö on rantautunut myös Suomeen.

Esimerkiksi entisestä pääministeristä Sanna Marinista on levitetty sosiaalisessa mediassa useita deepfakeja.

Jadoun toteaa, että nykyisin lähes kuka tahansa voi ilmaisten työkalujen ja valokuvan avulla luoda vaikkapa kasvojenvaihtovideon muutamassa minuutissa.

Jadoun antaa jälleen nopean näytöksen taidoistaan.

Ensin hän ottaa kännykällään valokuvan Ylen toimittajan kasvoista ja lataa sitten Youtubesta kohtauksen toimintaelokuvasta nimeltä ”XXX”.

Muutamien työvaiheiden jälkeen päänäyttelijän Vin Dieselin ja muiden elokuvan esiintyjien kasvot korvautuvat toimittajan kasvoilla.

Yle ei pyytänyt Jadounia käyttämään XXX-elokuvan kohtausta näytteenä. Jadoun sanoo valinneensa tämän klipin, koska kasvojen vaihto toimii parhaiten silloin, kun henkilöiden pään muodot muistuttavat toisiaan.

Alla olevalla videolla voit verrata toimittajaa ja Jadounin tekemää syväväärennöstä toisiinsa.

SYVÄVÄÄRENNÖKSIÄ EI PITÄISI sallia lainkaan vaaleissa. Niihin liittyy ennennäkemättömiä riskejä, sanoo tekoälyasiantuntija, professori Avik Sarkar ja antaa esimerkin.

Pääministeri Modin pitämää puhetta on käännetty Intiassa eri kielille reaaliajassa tekoälyn avulla.

Jos Modin puheesta muutettaisiin vain muutamia sanoja halventamaan tiettyjä ihmisryhmiä, sillä voisi olla väkivaltaisuuksiin johtava vaikutus, Sarkar kuvailee.

Sarkarin mukaan syväväärennökset ovat jo nyt aiheuttaneet Intiassa väkivaltaisuuksia, joissa on tuhoutunut omaisuutta ja jopa kuollut ihmisiä.

Sarkar vertaa tekoälyn voimaa ydinteknologiaan. Väärin käytettynä sen haitat voivat olla valtavat. Siksi hänen mielestään tekoälyn käyttöä pitää säännellä.

MYÖS DEEPFAKE-POMO Jadoun katsoo, että deepfake-teknologian käyttö vaatii sääntelyä, koska syväväärennösten yleistyminen rapauttaa luottamusta ja heikentää demokratiaa.

Professori Sarkar tarjoaa ratkaisuksi maailmanlaajuista järjestelmää, jossa sosiaalisen median käyttäjien identiteetit varmistettaisiin esimerkiksi lohkoketjuteknologian ja henkilöllisyystodistusten avulla.

Näin syväväärennösten levittäjät voitaisiin tarvittaessa jäljittää ja laittaa vastuuseen väärinkäytöksistä.

Sarkar ennustaa, että deepfake-teknologian pahimmat vaikutukset nähdään tulevaisuudessa ja vasta sen jälkeen ongelmaan puututaan poliittisesti.